随着人工智能技术的飞速发展,其双刃剑效应在网络安全领域愈发凸显。2025年,全球安全态势正面临一场由AI驱动的深刻变革,其中,暗网中基于AI的武器化工具升级与人工智能基础软件开发中的安全漏洞,构成了前所未有的严峻挑战。

一、暗网武器库的AI化升级:从自动化到智能化攻击

暗网已不再是简单的非法商品交易市场,而是演变为网络犯罪工具和服务的“创新工场”。攻击工具正经历从自动化脚本到智能化武器的质变。基于机器学习算法的恶意软件能够动态调整攻击模式,规避传统基于特征码的检测。例如,AI驱动的勒索软件可以自主识别高价值目标,并智能判断加密时机以最大化勒索成功率;而AI赋能的钓鱼攻击则能分析海量公开数据,生成高度个性化的欺诈信息,其逼真度令传统安全意识培训难以防范。更令人担忧的是,暗网中出现了“AI攻击即服务”(AIaaS)模式,降低了发动高级持续性威胁(APT)攻击的技术门槛,使更多犯罪团伙能够获得强大的攻击能力。

二、人工智能基础软件开发:安全漏洞的“新温床”

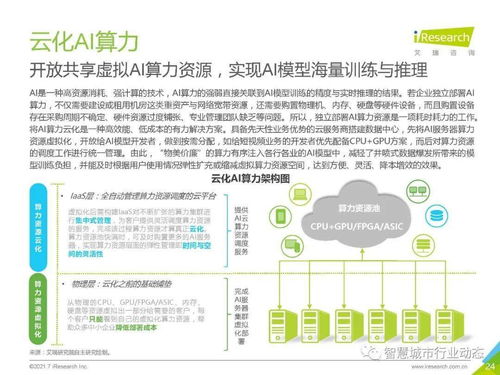

人工智能的繁荣高度依赖其基础软件,包括主流的机器学习框架(如TensorFlow、PyTorch)、大规模预训练模型以及各类AI开发平台。这些基础软件在设计之初往往优先考虑功能与性能,安全并非核心考量。其复杂性引入了新型漏洞:

- 供应链污染风险:AI开发严重依赖开源库和预训练模型。恶意行为者可能通过投毒训练数据、植入后门模型或在流行库中注入恶意代码,导致下游应用 inherit 安全缺陷。一旦某个广泛使用的框架或模型被污染,其影响将呈指数级扩散。

- 模型自身漏洞:对抗性攻击可以精心构造输入数据,导致AI模型做出错误判断,这在自动驾驶、内容过滤等安全关键领域后果严重。模型窃取、逆向工程等攻击可能窃取耗费巨资训练的核心算法与知识产权。

- 开发环境与工具链风险:集成的AI开发平台和自动化部署工具(MLOps)若存在配置错误或漏洞,可能成为攻击者渗透整个AI系统生命周期的入口。

这些漏洞与传统软件漏洞交织,形成了更隐蔽、更复杂的攻击面。攻击者不仅攻击AI系统本身,更开始利用AI系统作为跳板,攻击其所嵌入的更大规模的信息系统。

三、2025年全球安全态势:挑战与应对

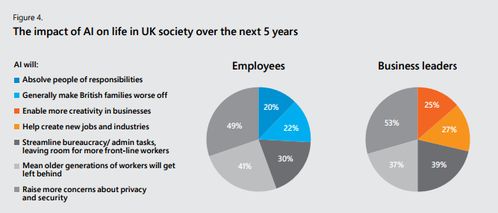

面对AI驱动的网络威胁升级,2025年的全球网络安全防线面临严峻考验:

- 防御不对称加剧:防御方需要持续投入巨大资源进行监测、分析与响应,而攻击方利用AI提升了攻击的效率、规模和隐蔽性,成本却可能降低。

- 传统防御体系失效:基于规则和已知特征的防御手段难以应对AI生成的、不断演变的新型威胁。零日漏洞的发现与利用因AI的辅助而可能更加频繁。

- 国家行为体与非国家行为体的博弈:国家支持的APT组织很可能率先装备最先进的AI攻击工具,用于情报收集、关键基础设施破坏或地缘政治博弈。技术的外溢也使恐怖组织、极端犯罪团伙的能力得到提升。

- 伦理与法规滞后:全球范围内,针对AI恶意使用的法律法规、跨境执法协作以及技术伦理规范仍处于起步阶段,难以对新型犯罪形成有效威慑。

四、构建面向未来的韧性安全体系

应对挑战,需要业界、学界与政府形成合力,构建适应AI时代的安全生态:

- 技术革新:大力发展“AI for Security”,即利用人工智能(如行为分析、异常检测、威胁预测)来增强防御能力。推动“Security for AI”,将安全设计(Security by Design)原则贯穿于AI基础软件和模型开发的全生命周期,包括安全编码、漏洞管理、模型鲁棒性测试和隐私保护技术(如联邦学习)。

- 协作与共享:建立跨行业、跨国界的威胁情报共享平台,特别是针对AI特有攻击模式的指标共享。推动AI安全标准与认证体系的建立。

- 能力建设:加强网络安全人才的AI技能培养,同时提升AI研发人员的安全意识。开展针对AI攻击的实战化演习,提升整体应对能力。

- 治理与法规:加快完善相关法律法规,明确AI恶意使用的法律边界与责任。推动国际对话,建立针对AI网络武器扩散的控制与治理机制。

2025年,人工智能在将网络安全攻防推向一个全新维度。暗网中AI武器的进化与基础软件中的安全脆弱性相互叠加,放大了系统性风险。这场博弈不仅是技术的竞赛,更是战略、协作与治理能力的综合较量。唯有以前瞻的视野、开放的合作和持续的创新主动塑造安全格局,才能驾驭技术浪潮,确保数字时代的稳定与繁荣。